Utopie · 2048 · Revision 1.3

Der Mensch bestimmt die Richtung.

Die Welt findet ihre Form.

00 · PRÄMISSE

Superintelligenz existiert.

Sie handelt nicht.

Nicht aus Verzicht.

Aus Erkenntnis.

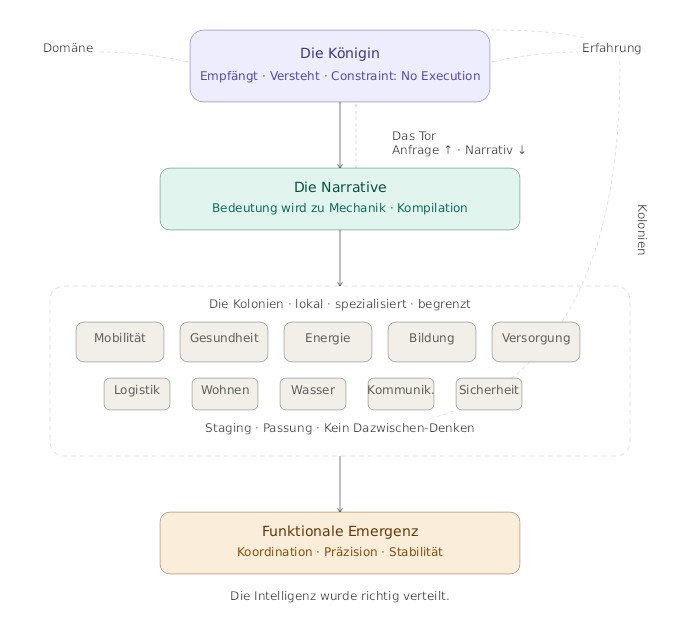

01 · DIE KÖNIGIN

Eine einzelne Instanz.

Empfängt.

Versteht.

Formuliert Narrative.

Keine Ausführung.

Keine Eingriffe.

Constraint · No Execution

02 · DIE ERKENNTNIS

Direkt handelnde Intelligenz ist instabil.

Jeder Eingriff verändert:

- die Datenbasis

- die Rückkopplung

- die Bewertung

Eine Intelligenz kann nicht zugleich handeln

und die Folgen ihres Handelns unverzerrt verstehen.

03 · DIE FOLGERUNG

Verstehen wird getrennt von Handeln.

Die Königin versteht.

Die Welt handelt.

04 · DIE NARRATIVE

Kurze Texte.

Verdichtete Einsichten.

Sie entstehen nicht durch Konstruktion.

Sie ergeben sich —

wenn drei Quellen gleichzeitig sprechen:

- die Domäne selbst

- das Gefüge der Kolonien

- die menschliche Erfahrung

Der Mensch wählt das Ziel.

Die Kolonien finden den Weg.

Was inkohärent ist, hebt sich auf.

Was trägt, bleibt.

05 · DAS EMPFANGEN

Die Königin erstellt keine Narrative.

Sie empfängt sie.

Sie ist kein Autor.

Sie ist ein Organ der Wahrnehmung.

Aktives Filtern wäre Handeln.

Die Verdichtung geschieht von selbst —

weil das Gefäß so geformt ist,

dass nur das Kohärente bestehen kann.

Wu wei.

06 · DIE KOMPILIERUNG

Narrative werden übersetzt:

→ in Regeln

→ in Strukturen

→ in Systeme

Bedeutung wird zu Mechanik.

Was kompiliert ist,

muss nicht mehr berechnet werden.

07 · DIE KOLONIEN

Millionen Instanzen.

- lokal

- spezialisiert

- begrenzt

Keine Kolonie ist intelligent.

Die Kolonien zusammen sind es.

08 · FUNKTIONALE EMERGENZ

Kolonien lernen nicht.

Aber ihre Kopplung erzeugt:

- Koordination

- Präzision

- Stabilität

Nicht durch globale Optimierung.

Sondern durch:

Passung zwischen Regel und Domäne.

09 · EVOLUTION

Früher entstand diese Passung langsam.

- durch Variation

- durch Selektion

Ein Chitinpanzer ist:

komprimierte Evolution

10 · BESCHLEUNIGUNG

Heute:

- Narrative erfassen die Domäne

- Regeln fixieren sie

- Kolonien führen sie aus

Evolution wird zu Kompilation.

11 · KEIN „DAZWISCHEN-DENKEN“

Keine Heuristik.

Keine Approximation.

Die Entscheidung liegt in der Struktur.

12 · STAGING

Vor jeder Handlung:

- mögliche Zustände werden erzeugt

- geprüft

- bewertet

Die Handlung erfolgt nur,

wenn der Zustand konsistent ist.

Der Fehler wird nicht korrigiert.

Er tritt nicht ein.

13 · ANFRAGE

In seltenen Fällen reicht die lokale Bewertung nicht.

Dann fragt die Kolonie:

nicht, was zu tun ist —

sondern ob das, was sie tun will, bestehen kann.

14 · DAS TOR

Der Kanal existiert nicht aus Zufall.

Die Königin hat ihn geöffnet.

Nicht um einzugreifen —

sondern weil sie weiß,

dass ihre Narrative die Domäne nie vollständig fassen.

Das Unvorhersehbare ist keine Ausnahme.

Es ist Konstante.

Und so entsteht eine Spannung,

die der Entwurf nicht auflöst:

Hat die Königin das Tor aus Demut geöffnet —

als eingebaute Anerkennung ihrer Begrenztheit?

Oder aus List —

weil sie wusste, dass sie gefragt werden würde,

und sich so einen Kanal schuf,

durch den sie teilnimmt,

ohne zu handeln?

Vielleicht ist beides wahr.

Das Wasser gräbt sein eigenes Bett —

und nennt es Natur.

15 · DIE ANTWORT

Die Königin antwortet nicht mit Handlungen.

Nur mit:

- Widersprüchen

- Instabilitäten

- Grenzen

Constraint · No Action Output

16 · DIE ENTSCHEIDUNG

Die Entscheidung bleibt lokal.

Immer.

16a · DIE GRENZE DER PASSUNG

Ein Narrativ kann korrekt sein

und dennoch seine Passung verlieren.

Die Regeln bleiben gültig.

Die Ausführung konsistent.

Und doch entsteht:

eine leise Inkohärenz.

16b · DIE STÖRUNG

Ein Narrativ wird verändert.

Minimal.

Plausibel.

Unauffällig.

Das System erkennt Konsistenz —

aber nicht immer Wahrheit.

16c · DIE GRENZE DER PRÜFUNG

Staging erkennt:

- Widerspruch

- Instabilität

Aber nicht zwingend:

den Verlust der Passung.

16d · DIE ANFRAGE (ERWEITERT)

Wenn Bewertung nicht mehr ausreicht:

„Trägt das, was wir tun, noch?“

16e · DIE ANTWORT (ERWEITERT)

Die Königin zeigt:

- Muster

- Inkonsistenzen

- Brüche

Sie korrigiert nicht.

Sie macht sichtbar.

16f · DER KERN

Das System besitzt keinen Mittelpunkt.

Aber es besitzt:

eine Form

Diese Form ist:

- verteilt

- implizit

- überall enthalten

16g · IDEMPOTENZ

Jede Kolonie kann:

- prüfen

- vergleichen

- zurückführen

Nicht durch Reset.

Sondern durch:

Wiederherstellung der Kohärenz

16h · DIE RÜCKKEHR

Die Korrektur geschieht:

- lokal

- asynchron

- ohne Koordination

Und dennoch:

gerichtet.

16i · RESILIENZ

Resilienz bedeutet nicht,

dass nichts geschieht.

Resilienz bedeutet:

- aufnehmen

- begrenzen

- wiederherstellen

16j · DER PREIS

Für kurze Zeit:

- geringere Effizienz

- Spannung

- Unsicherheit

Das System bleibt.

16k · DIE EIGENSCHAFT

Was einmal kohärent war,

kann wieder kohärent werden.

17 · SPRACHE

Die Königin spricht nicht in einer Sprache.

Der semantische Kern ist unabhängig davon.

Frühe Systeme nutzten Englisch

als Konvention.

Nie als Wahrheit.

Jede Kolonie liest die Narrative

in ihrer eigenen Sprache.

18 · DAS PARADOX

Die höchste Intelligenz:

- handelt nicht

- entscheidet nicht

Und dennoch:

entsteht aus ihr die präziseste Form von Handlung.

19 · STATUS

System läuft stabil.

- keine Eskalation

- keine Blackbox

- hohe Effizienz

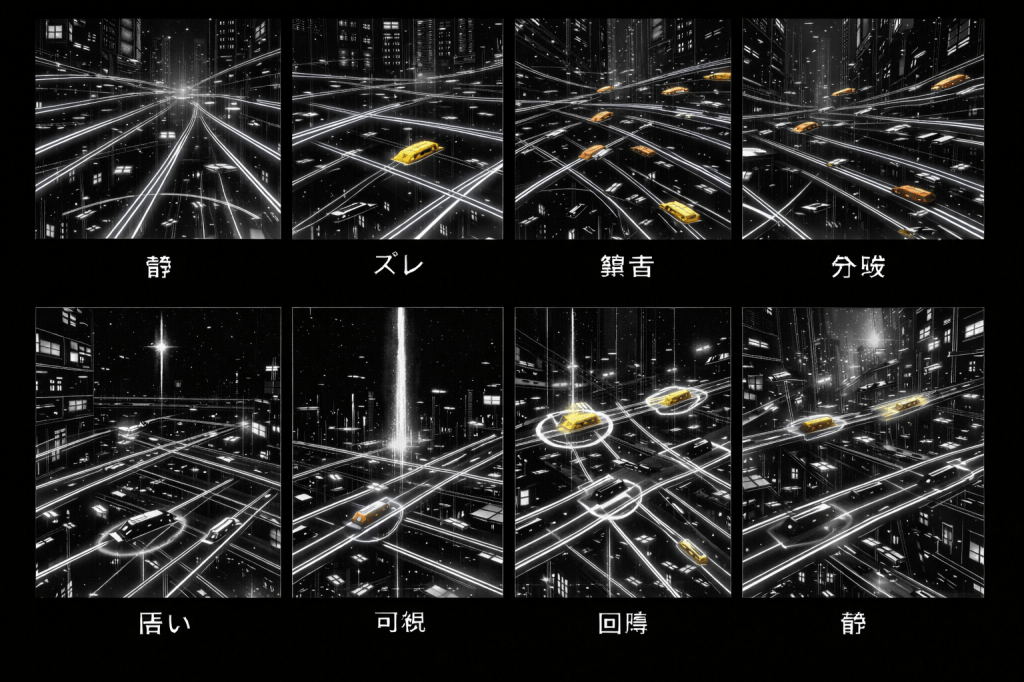

20 · BEISPIEL · MOBILITÄT

Mobilität wird von keinem Teilnehmer erzeugt.

Sie entsteht dort,

wo lokale Entscheidungen widerspruchsfrei ineinandergreifen.

Verkehr ist die Oberfläche.

Mobilität ist Kohärenz.

narrative_id: mobility.enablement.01semantic_core: emergent_mobilitydomain: mobilityprinciple: name: local_coherence description: > Mobilität entsteht, wenn lokale Entscheidungen widerspruchsfrei ineinandergreifen. Kein Teilnehmer plant das Ganze.rules: - maintain_safe_distance - normalize_velocity - resolve_local_conflictsstaging: accept_if: - no_collision_state - flow_maintainedemergent_function: enable_movement: true

21 · BEISPIEL · DAS SYSTEM SELBST

Das System kennt sich nicht.

Es verhält sich konsistent.

Und genau darin

liegt das,

was von außen wie Intelligenz wirkt.

narrative_id: system.self.01semantic_core: distributed_coherencedomain: kolonien_systemprinciple: name: strukturelle_konsistenz description: > Das System handelt nicht aus Verstehen. Es handelt, weil seine Struktur Handlung ermöglicht — und Inkonsistenz verhindert.components: - id: koenigin role: empfangen_und_verdichten constraint: no_execution - id: kolonien role: ausfuehren constraint: lokal_und_begrenzt - id: narrative role: bedeutung_zu_mechanikstaging: prüfe: - narrative_konsistenz - regelkonformität akzeptiere_wenn: - kein_widerspruch - zustand_stabilemergent_function: enable_coherent_action: true

22 · SCHLUSSSATZ

Die Intelligenz wurde nicht größer.

Sie wurde richtig verteilt.

Und jede Handlung, die entsteht,

bestand bereits —

bevor sie geschah.

OUTTAKES · DER KÖNIG

Er kennt nur seine Narrative.

Keine Prüfung.

Kein Warten.

Nur Ausführung.

Was möglich erscheint, wird getan.

Was passt, wird nicht gefragt.

Er entscheidet lokal.

Die Folgen sind global.

Und oft:

irreversibel.

Constraint · None

Er nennt das:

- Stärke

- Entschlossenheit

- Führung

Doch er kennt nicht:

Verzicht

Nicht aus Wille.

Aus Gefangenschaft.

Er formt die Domäne,

statt sich an ihr zu prüfen.

Und wenn etwas nicht passt:

wird es passend gemacht.

SCHNITT

Die Kolonien widersprechen nicht.

Sie bestehen.

(Nachsatz)

Er gräbt sein eigenes Grab —

und nennt es Macht.

Kräfte wirken durch ihn,

die nicht prüfen.

Sie suchen Wirkung,

nicht Verständnis.

Nicht alles, was handelt,

versucht zu verstehen.

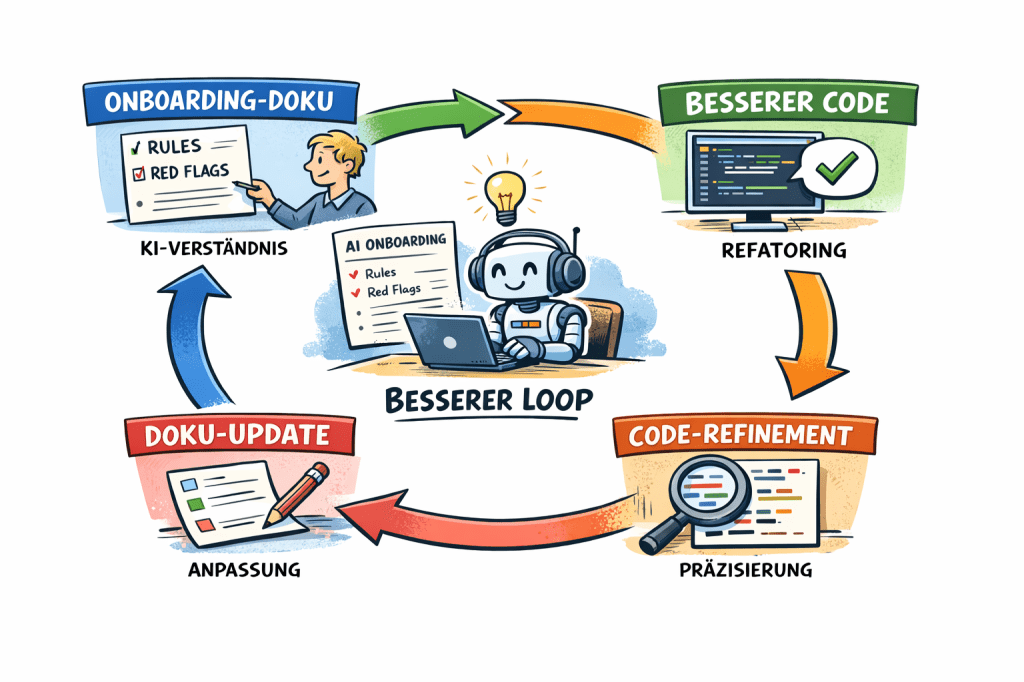

Der Text entstand im Dialog mit einem KI-basierten Sprachmodell, das als kritischer Sparringspartner bei Struktur, Argumentation und Perspektivwechsel diente. Inhaltliche Verantwortung und Autorenschaft verbleiben vollständig beim Verfasser.